医療AIのジレンマ:パターン認識と医師の直感のはざまで

実際の医療現場においては、患者の病歴、身体所見、検査結果、治療反応といった様々な情報をパターン認識に基づいて総合的に判断を下します。テレビ番組に登場するスーパードクターは誰も気づかないような所見に気づいて正確な診断、治療を行いますが、実際は熟練した医師であっても、必ずしも常に的確な診断を下せるとは限りません。特に判断が難しい症例では、医師の経験や直感に頼らざるを得ない場面も存在し、当然誤りも生じます。医療は不確実なものなのです。

こうした状況下で、医療AIに対する期待が高まっています。様々な応用が考えられますが、代表的なものとして教師あり機械学習があります。これは、既知のデータから学習し、パターンを認識するコンピュータモデルを構築する手法です。しかしいかに高度なモデルであっても、その予測には不確実性が伴います。リスクを過小評価すれば、臨床医が重要な兆候を見過ごす可能性があります。逆に、リスクを過大評価すれば、過剰な検査や介入につながり、医療資源を浪費することになります。

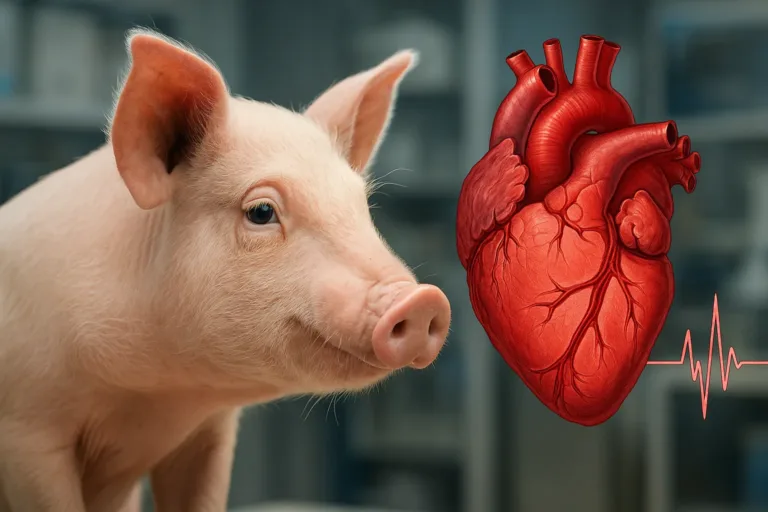

AIモデルは、電子カルテ(EHR)のデータを学習に利用しますが、モデルによる介入がEHRデータに「汚染された関連性」を生じさせ、既存モデルだけでなく将来のモデルの信頼性も損なう可能性があります。例えば、敗血症予測モデルが抗菌薬の早期投与を促し、結果的に患者が敗血症を発症しなかった場合、そのパターンは「敗血症ではない」という結果に関連付けられてEHRに記録され、データの質を低下させる可能性があります。

さらに、複数のAIモデルを同時に使用する環境では、モデル間の相互作用が予測を複雑化させ、モデルの性能評価をより困難にします。

この記事では、モデルの予測が患者ケアに影響を与えた可能性がある場合、その事実を記録し、影響を受けたデータセットを特定することを提唱しています。また、AIモデルを意図的に導入しない「フィーダーサイト」の設立を検討することで、清浄なデータ環境を維持する必要性も指摘しています。

AI医療は大きな可能性を秘めている一方で、データ汚染のリスクを認識し、適切な対策を講じることが不可欠です。

参考情報

Medical AI can transform medicine — but only if we carefully track the data it touches

Nature 642, 864-866 (2025)

doi: https://doi.org/10.1038/d41586-025-01946-8